NTIRE 2021 三冠一亞 | BasicVSR 加強版超分算法!

在 NTIRE 2021 上,商湯科技-南洋理工大學聯合 AI 研究中心 S-Lab 對 BasicVSR 傳播和對齊模塊作出進一步設計,提出了 BasicVSR++。通過提出的二階網格傳播(second-order grid propagation) 和光流引導可變形對齊 (flow-guided deformable alignment),BasicVSR++ 在大約相同參數量下大幅度超過現有方法。更重要的是,BasicVSR ++ 可以擴展到不同的視頻恢復任務中。在 NTIRE 2021 中,BasicVSR ++ 在視頻超分和壓縮視頻增強任務中獲得三冠一亞的優異成績。

論文名稱:BasicVSR++: Improving Video Super-Resolution with Enhanced Propagation and Alignment

Part 1 問題和挑戰

視頻超分辨率的其中一個難點是需要從高度相關但未對齊的視頻幀中收集補充信息以進行恢復。循環 (Recurrent) 結構是用于視頻超分辨率任務的流行框架選擇。通常,在循環模型中跨幀傳輸長期信息和對齊特征的問題仍然是一個很艱巨的任務。在 CVPR 2021 提出的 BasicVSR [1] 采用具有特征對齊功能的雙向傳播,可以有效地利用整個輸入視頻中的信息。它能夠充當簡單但強大的 backbone,可以在其中輕松添加組件以提高性能。但是,它在傳播和對齊方面的基本設計限制了信息聚合的功效。我們從不同的實驗可以觀察到,現有方法一般難以恢復精細的細節,尤其是在處理遮擋的復雜區域時。因此,我們有必要在傳播和對準方面進行精細設計。

Part 2 方法介紹

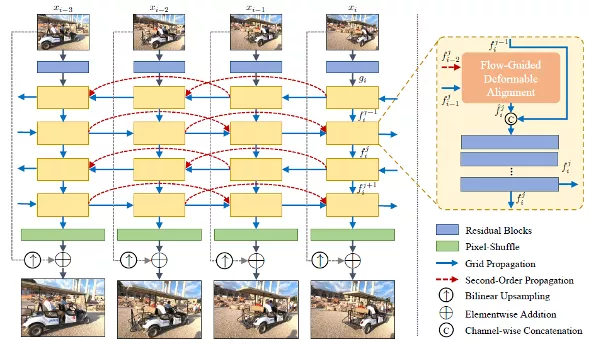

為了更有效地傳播和聚集信息,在這項工作中,我們通過設計二階網格傳播 (second-order grid propagation) 和光流引導可變形對齊 (flow-guided deformable alignment) 來改進 BasicVSR。下圖是 BasicVSR ++ 的概述:

Second-Order Grid Propagation:二階網格傳播解決了 BasicVSR 中的兩個局限性:i)我們利用如圖所示的網格傳播方式進行更有效的雙向信息聚合,并且 ii)放松了在BasicVSR中一階馬爾可夫性質的假設,并將二階連接整合到網絡中,以便可以從不同的時空位置聚合信息。以上兩方面的修改都改善了網絡中的信息聚合能力,并提高了網絡對遮擋區域和精細區域的魯棒性。

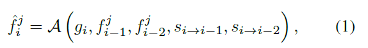

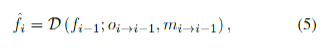

為了計算特征,我們首先使用我們提出的的光流引導可變形對齊進行特征對齊:

然后把這些特征連接起來并輸進殘差模塊中:

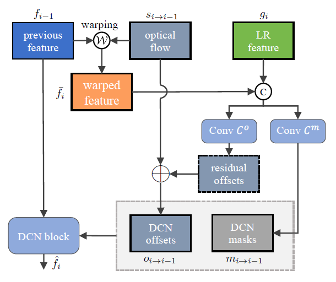

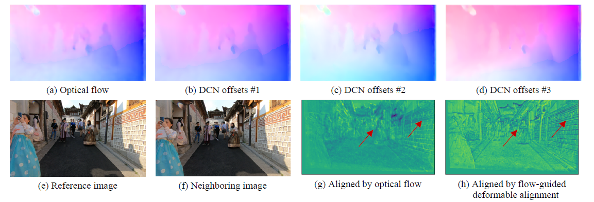

Flow-Guided Deformable Alignment:由于在可變形卷積 (DCN) 中引入了多樣的偏移量,可變形對齊跟光流對齊相比有著顯著改善。然而,可變形對齊模塊可能很難訓練。訓練的不穩定性通常會導致偏移量溢出 (overflow),從而使最終性能下降。為了利用 DCN 偏移量的多樣性且保證其訓練的穩定性,我們提出了光流引導的可變形模塊。這是由可變形對準和基于流的對準之間的緊密關系所激發的[3]。我們先討論一階設定,結構如下圖所示:

給定從 LR 圖像計算出的特征,為先前時間步計算出的特征以及到前一幀的光流,我們首先使用光流大致對齊特征:

然后將預對齊的功能用于計算 DCN offsets 和 modulation masks。這里值得留意的是,我們不直接計算 offsets, 而是計算光流的殘差。

然后把 DCN 應用于未對齊的特征:

以上公式僅設計用于對齊單個特征,因此不適用于我們的二階傳播。適應二階設置的最直觀方法是將上述過程分別應用于兩個特征。但是,這需要加倍的計算,從而導致效率降低。此外,單獨的對齊方式可能會忽略來自特征的補充信息。因此,我們需要允許同時對齊兩個特征。更具體地說,我們將扭曲的特征和光流連接起來來同時計算一階和二階的偏移量:

然后同樣地把 DCN 應用于未對齊的特征:

與直接計算 DCN offsets 的現有方法不同,我們提出的光流引導可變形對齊采用光流作為初始偏移量。這個設計有兩個好處。首先,由于 CNN 只具有局部感受野,因此可以通過使用光流對特征進行預對齊來輔助偏移量的學習。其次,通過僅學習殘差,網絡僅需要學習與光流的微小偏差,從而減少了之前可變形對齊模塊的負擔。此外, DCN 中的 modulation mask 可以用作一個注意機制以自適應地調節不同像素的權重,從而提供額外的靈活性。

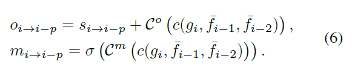

Part 3 實驗結果

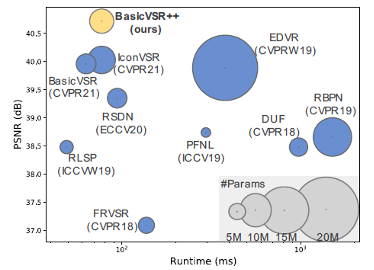

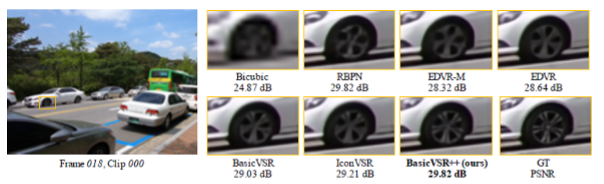

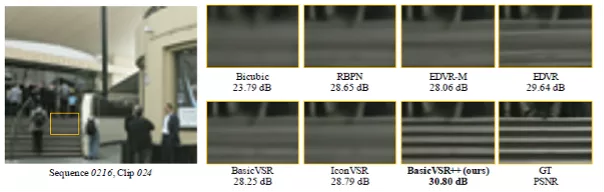

上圖的定量實驗可以證實 BasicVSR ++ 的有效性。跟 sliding-window 方法相比, BasicVSR++ 能在更少參數量下達到更優秀的效果。例如,BasicVSR++ 只需要 EDVR 35% 的參數量便能大幅度超越 EDVR。另外,在大致相同的參數量下,BasicVSR++ 大幅超越 BasicVSR 和 IconVSR。這些都能證明 BasicVSR++ 的優越性。從下圖兩個較困難的例子我們可以看出, 通過我們提出的改進模塊,BasicVSR++ 能跟有效的把視頻的信息利用起來,相對之前的方法,可以恢復出更多的紋理細節。

Part 4 消融實驗

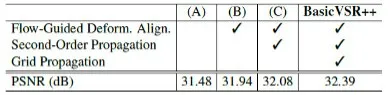

接著,我們通過消融實驗分析我們提出的部件。

從上圖可以看出,我們提出的部件均對最終的效果有著明顯的作用,我們的 BasicVSR++ 比起沒有部件的 baseline 高出 0.91 dB,證明了部件的有效性。

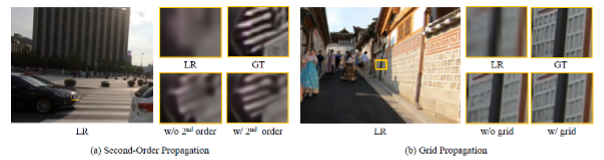

Second-Order Grid Propagation:我們進一步提供一些定性比較,以了解所提出的傳播方案的貢獻。如上圖所示,在包含精細細節和復雜紋理的區域中,二階傳播和網格傳播的貢獻更加明顯。在那些區域中,來自當前幀的有限信息可用于重建。為了提高這些區域的輸出質量,必須從其他視頻幀進行有效的信息聚合。利用我們的二階傳播方案,可以通過可靠而有效的傳播來傳輸信息。這些補充信息實質上有助于恢復精細的細節。如示例所示,加入我們設計組件的網絡可以成功恢復細節紋理,而去掉這些組件的網絡則輸出相對模糊的結果。

Flow-Guided Deformable Alignment:在上圖中,我們將偏移量 (DCN offsets) 與光流進行了比較。通過僅學習光流中的殘差,網絡可產生與光流高度相似但具有可觀察差異的 offsets。當與僅從運動(光流)指示的一個空間位置聚合信息的基線進行比較時,我們提出的模塊允許從周圍的多個位置檢索信息,從而提供更大的靈活性。這種靈活性能有效提升特征的質量。當使用光流執行變形時,由于空間變形中的插值操作,對齊的特征包含模糊的邊緣。相反,通過從附近區域收集更多信息,我們提出的模塊所對準的特征更加清晰,并保留了更多細節。

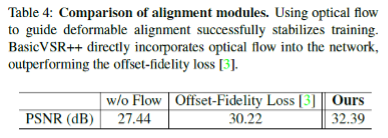

接著,為了展示我們設計的優越性,我們將對齊模塊與兩個變體進行了比較:(1)不使用光流。(2)補償保真度損失 [2],即該光流僅用作損失函數中的監督(而不是像我們的方法那樣用作基本 offset)。如下表所示,不使用光流作為指導,不穩定會導致訓練崩潰,從而導致非常差的 PSNR 值。使用偏移保真度損失時,訓練能穩定下來。但是,但 PSNR 跟 BasicVSR++ 比較下降了 2.17 dB。我們的改進對齊方式直接將光流合并到網絡中,以提供更明確的導引,從而產生更好的結果。

Part 5 結語

在這項工作中,我們用兩個新穎的組件改進了 BasicVSR,以增強其在視頻超分辨率任務中的傳播和對齊性能。我們的模型 BasicVSR ++ 在保持效率的同時,大大超越了現有的方法。這些設計可以很好地推廣到其他視頻還原任務,包括壓縮視頻增強。BasicVSR++ 在今年 NTIRE 2021 中不同視頻復原任務中取得三冠一亞的優異成績。該方法也許對其他視頻增強或復原任務(如去模糊和去噪)也會有更好的效果,感興趣的同學可以去嘗試。

Part 6 作者介紹

陳焯杰 (Kelvin C.K. Chan) | 南洋理工大學 S-Lab 和 MMLab@NTU 三年級博士生。在頂級會議上發表過五篇論文,在 NTIRE 視頻復原比賽中共獲得七個冠軍。導師是呂健勤 (Chen Change Loy) 副教授。當前主要研究興趣為圖像和視頻復原,主要包括超分辨率和去模糊等。

個人主頁:https://ckkelvinchan.github.io/

實驗室主頁:https://www.mmlab-ntu.com/

論文地址

https://arxiv.org/abs/2104.13371

Reference

[1] Kelvin C.K. Chan et al. "BasicVSR: The Search for Essential Components in Video Super-Resolution and Beyond." CVPR, 2021.

[2] Kelvin C.K. Chan et al. "Understanding Deformable Alignment in Video Super-Resolution." AAAI, 2021.

返回

返回

人工智能基礎設施

人工智能基礎設施 企業服務智能化

企業服務智能化 城市管理智能化

城市管理智能化 汽車出行智能化

汽車出行智能化 個人生活智能化

個人生活智能化