ICCV 2021 _ 當圖卷積遇上多視角3D人體姿態估計

Graph-Based 3D Multi-Person Pose Estimation Using Multi-View Images

Size Wu1,3 Sheng Jin2,3 Wentao Liu3 Lei Bai4 Chen Qian3 Dong Liu1 Wanli Ouyang4 1University of Science and Technology of China 2The University of Hong Kong 3SenseTime Research and Tetras.AI 4The University of Sydney

Wsz32741010@mail.ustc.edu.cn {jinsheng, liuwentao, qianchen}@sensetime.com baisanshi@gmail.com dongeliu@ustc.edu.cn wanly.ouyang@uni.sydney.edu.au

Part 1 動機和背景

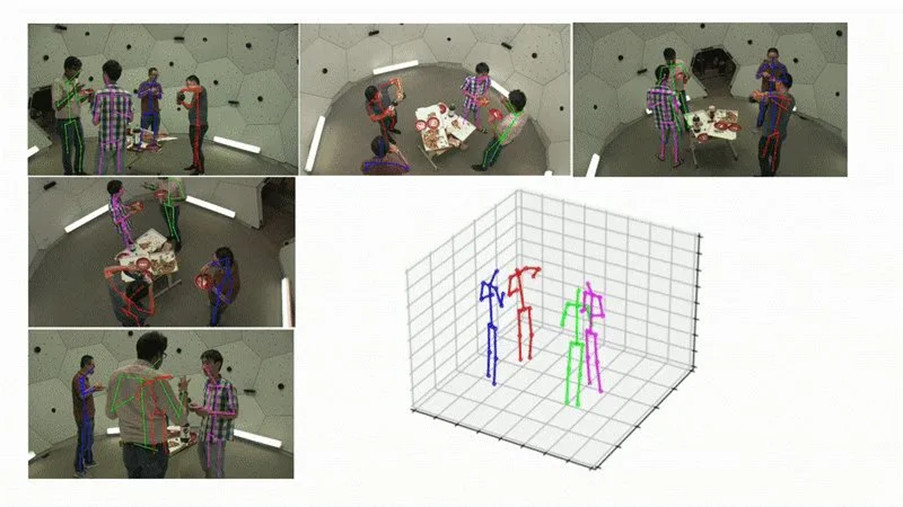

圖 1 本文算法的可視化展示

多視角的多人3D姿態估計,指從多個相機(已標定)拍攝的圖像中,恢復出該場景的所有的人體骨架。它是視頻動作分析和高級人機交互的基礎,在運動分析、影視特效等領域具有重要的應用前景。

目前多視角3D人體姿態估計有如下兩種主流方案:

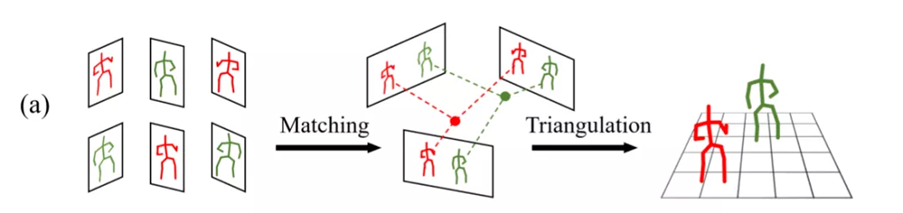

圖 2 匹配+三角化重建算法的示意圖

(a) 匹配+三角化重建(Triangulation):首先,檢測各個視角的 2D 人體骨架;再利用幾何關系計算距離,進行多視角人體的匹配;最終,利用多視角的2D坐標和相機參數,計算出3D坐標。

代表方法:MVPose[1]

缺點:(1)方法的精度十分依賴 2D 檢測結果。2D 檢測的誤差會影響匹配的效果,錯誤的匹配進一步導致異常的重建;2D 的誤差也會影響 3D 重建的精度。(2)匹配部分和三角重建部分并不是數據驅動的,沒有監督訓練和損失反傳。

圖 3 3D空間體素化算法的示意圖

(b) 3D空間體素化:將 3D 空間等距地劃分為一個個小網格,通過概率模型或者 3D 卷積神經網絡(CNN)檢測關鍵點。

代表方法:VoxelPose[2]

缺點:(1)空間體素化的精度會受到網格大小的制約,會產生量化誤差;(2)空間體素化在相同的精度下,計算復雜度隨空間大小三次方增長,無法應用于較大場景。

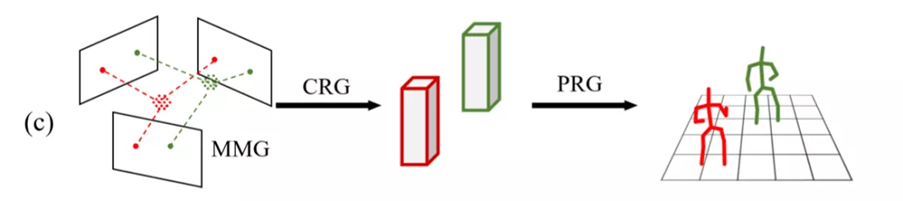

圖 4 本文算法的示意圖

(c) 本文方法:我們結合兩者的優勢,提出了一種基于圖卷積神經網絡的,自頂向下(Top-down)的兩階段算法。我們的整體算法流程,分為兩個階段:3D人體中心點定位+3D人體姿態估計。

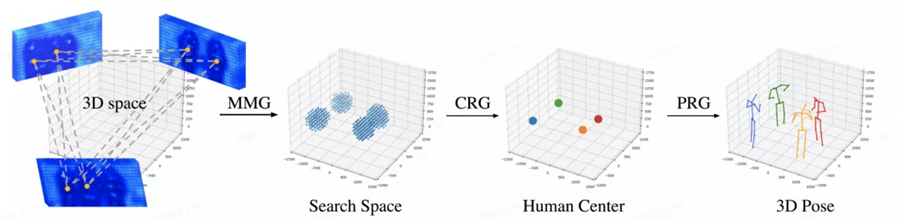

圖 5 本文方法的整體框架圖

1. 針對3D人體中心點定位,我們采用了proposal-refine "由粗到精"的策略。首先進行”粗篩選”,預測一系列候選中心點位置(MMG);再在候選中心點附近“精細”搜索(CRG),得到精確的人體中心點定位結果。

優點:(1)現有方法在融合多視角的特征時,通常直接級聯或池化各個視角的特征向量,忽視了視角之間的相互關系。我們利用圖卷積網絡,能夠有效利用跨視角的特征。(2)我們的"由粗到精"策略,能夠有效提升模型的預測精度。(3)搜索空間被限制在了候選中心點附近,與實際的空間大小無關,大大降低了運算復雜度。

2. 針對3D人體姿態估計,我們同樣采用"由粗到精"的策略,首先用模型預測初始3D人體姿態,再共同利用人體骨架結構信息和多視角特征,來優化預測的結果(PRG)。

優點:我們采用了"由粗到精"策略。圖卷積神經網絡PRG,能夠直接對人體骨架結構進行建模,利用骨架約束,優化了模型的預測結果。

Part 2: 方法

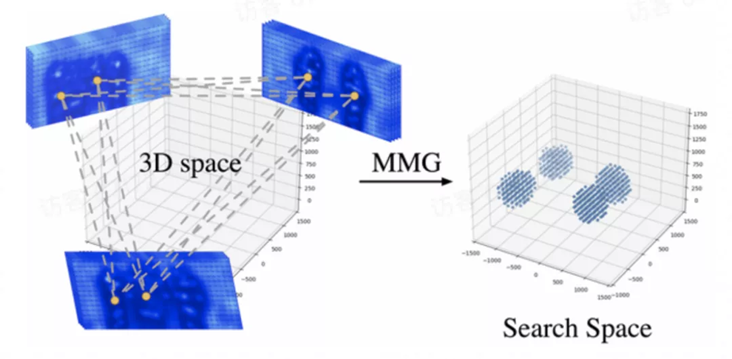

2.1 中心點候選區域生成:Multi-view Matching Graph(MMG)

我們設計了多視角匹配圖神經網絡(MMG),判斷不同視角的兩兩2D中心點,是否屬于同一個人。隨后,對于屬于同一個人的一對關鍵點,兩兩重建出一個3D坐標作為候選中心點。

圖 6 MMG模塊示意圖

建圖(Graph Construction):我們利用各個視角檢測得到的人體2D中心點,來構造跨視角圖模型。圖模型的“節點”為 各個視角檢測到的2D人體中心點;節點的特征為:2D人體中心點位置的圖像特征。圖模型的“邊”,兩兩連接不同視角的節點,兩個節點對應的2D中心點的極線距離作為邊特征。

信息傳遞(Message Passing):利用GNN來進行相關性特征的學習。我們使用EdgeConv來搭建圖卷積神經網絡模型,對所構造好的Graph 進行卷積,不斷更新節點的特征;通過圖的表征,模型同時利用了幾何信息(邊特征)和圖像信息(節點特征),高效的融合多視角特征,匹配精度遠高于直接利用極線匹配。

判斷邊的屬性:訓練一個邊判別器(Edge Discriminator),對每一對中心點(即一個邊)進行判別,判斷這一對中心點是否屬于同一個人。

提出候選點:每一對被判斷為同一個人的中心點,通過三角化重建出一個3D候選點。

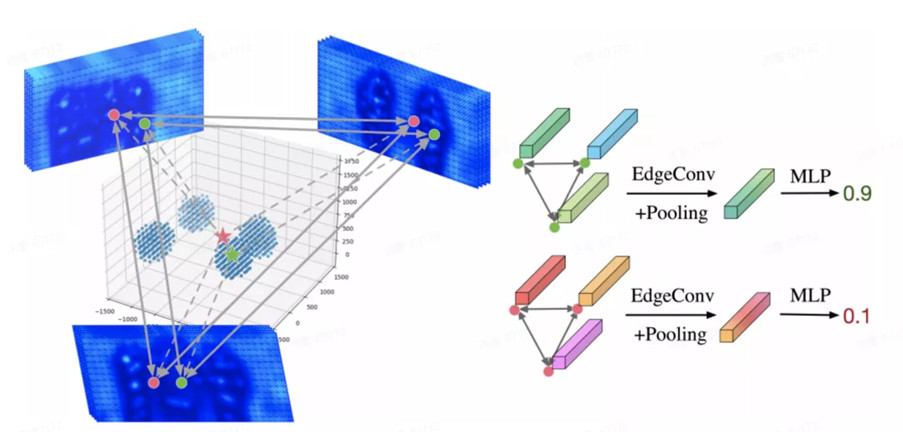

2. 2 中心點坐標優化:Center Refinement Graph(CRG)

有了候選中心點后,我們以候選點為球心的球形范圍作為搜索空間,靈活地在候選區域采樣。對于每個采樣點,將采樣點投影到各個視角并在相應位置提取特征。接著利用中心點優化圖模型(CRG),通過多個視角節點的連接,實現了高效的多視角特征融合,可以準確地判斷采樣點是否為人體中心點。

圖7 CRG模塊示意圖

搜索空間:以候選點為球心的球形范圍作為搜索空間,所有搜索空間的并集作為總的搜索空間。

采樣:我們可以進行適應性的采樣,先在搜索空間中等距采樣,用中心點圖卷積網絡檢測中心點,在檢測到的中心點周圍進一步精細采樣,以獲得更精確的位置。

建圖(Graph Construction):對每一個3D 采樣點,構建一個圖模型。其中,節點和節點特征分別對應 3D采樣點投影到各個視角后的2D位置 以及 該位置的圖像特征。圖中的邊,對各個節點進行全連接。

信息傳遞(Message Passing):利用GCN來進行相關性特征的學習。我們使用EdgeConv來搭建圖卷積神經網絡模型,利用多層圖卷積不斷更新節點的特征。

判斷圖的屬性:首先對圖中節點進行全局池化,得到圖的特征,再訓練一個多層感知機MLPs,判斷圖的屬性:判斷采樣點是否為人體中心,即輸出每個采樣點為人體中心的置信度。

非極大值抑制 (NMS):得到每個采樣點的置信度后,通過NMS操作,獲得優化后的人體中心點坐標。

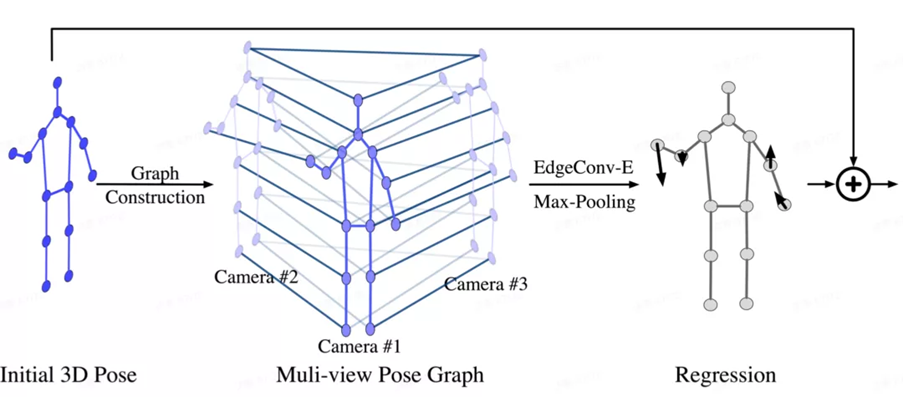

2. 3 人體姿態優化:Pose Regression Graph(PRG)

圖8 PRG模塊示意圖

我們采用"由粗到精"的策略,來估計人體3D姿態。首先,我們采用現有的姿態估計方法[2],得到初始的3D人體姿態(Initial 3D Pose);為了提升人體關鍵點的預測精度,本文提出了人體姿態回歸圖模型(Pose Regression Graph, PRG),利用圖卷積,高效地融合多視角的特征和人體的拓撲結構信息(頭和脖子相連,手和胳膊相連等),回歸出每個關鍵點坐標的修正值。

建圖(Graph Construction):首先將初始3D人體姿態,投影到各個相機視角,得到各個視角的2D人體姿態。利用各個視角下的2D人體關鍵點,構造跨視角姿態圖(Multi-view Pose Graph)。

圖模型的每個“節點”代表各個視角的每個2D關鍵點。節點的特征包括:關鍵點的類別信息,2D關鍵點位置處的圖像特征,以及初始3D人體姿態中對應關鍵點的置信度。

圖模型的“邊”代表節點之間的關系,共包括兩種類型的邊:跨視角且相同類型關鍵點間的連接邊 和 單視角且不同類型關鍵點間的連接邊。

信息傳遞(Message Passing):利用GCN來進行相關性特征的學習。我們使用EdgeConv來搭建圖卷積神經網絡模型,對所構造好的Graph 進行卷積,不斷更新節點的特征;完成多視角特征的更新和融合后,對相同類型的關鍵點特征進行最大值池化,得到一副人體骨架。

回歸修正值(Regression):使用回歸模型,預測出 Nx3 維的偏移向量(其中,N代表關鍵點個數),代表相對于初始3D人體姿態的修正值。

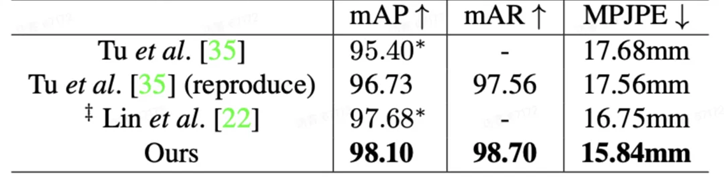

Part 3: 實驗結果

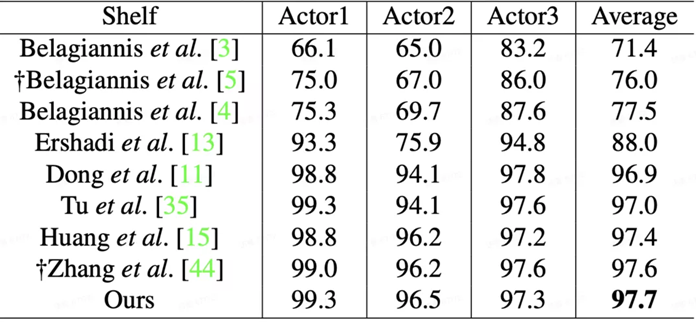

我們在 CMU Panoptic 和 Shelf 兩個主流的數據集上做了實驗。定量實驗表明,我們提出的算法,取得了最優的精度。而且在計算量和耗時方面,我們的方法相比之前的SOTA也有明顯優勢。

表1 CMU Panoptic 數據集的定量結果對比

表2 Shelf 數據集的定量結果對比

Part 4: 總結與展望

在本文中,我們提出了一套自頂向下的多視角3D人體姿態估計解決方案。我們針對該任務,精心設計了各類“多視角”圖卷積神經網絡(MMG, CRG, PRG)來提取人體結構性特征。我們在各數據集上的實驗,也充分證明了我們算法的有效性。關于對未來的展望,我們將繼續研究把算法擴展到時序,實現更高效的多視角人體姿態跟蹤。在方法層面,如何更加合理地利用相機的幾何信息,設計更高效的圖卷積神經網絡,是一個重要的改進方向。

Reference:

[1] Dong, J., Jiang, W., Huang, Q., Bao, H., & Zhou, X. (2019). Fast and robust multi-person 3d pose estimation from multiple views. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 7792-7801).

[2] Tu, H., Wang, C., & Zeng, W. (2020). Voxelpose: Towards multi-camera 3d human pose estimation in wild environment. In Computer Vision–ECCV 2020: 16th European Conference, Glasgow, UK, August 23–28, 2020, Proceedings, Part I 16 (pp. 197-212). Springer International Publishing.

返回

返回

人工智能基礎設施

人工智能基礎設施 企業服務智能化

企業服務智能化 城市管理智能化

城市管理智能化 汽車出行智能化

汽車出行智能化 個人生活智能化

個人生活智能化